Si bien el laboratorio de inteligencia artificial se creó hace ya casi dos años, recién en diciembre de 2024 llegó DeepSeek-V3, la tercera versión de la herramienta que logró irrumpir con fuerza en el mercado.

DeepSeek, la IA china que puede poner en jaque el uso cotidiano de Chat GPT y la venta de chips

Irrumpió con un formato similar, pero con ahorro de energía y un mecanismo de selección eficiente. Qué dice la herramienta sobre sí misma.

La firma china fundada por Liang Wenfeng y con sede Hangzhou se convirtió en un furor viral por las capacidades de su IA, las cuales, a pesar de las notorias diferencias, ya es comparada con GPT-4 de OpenAI.

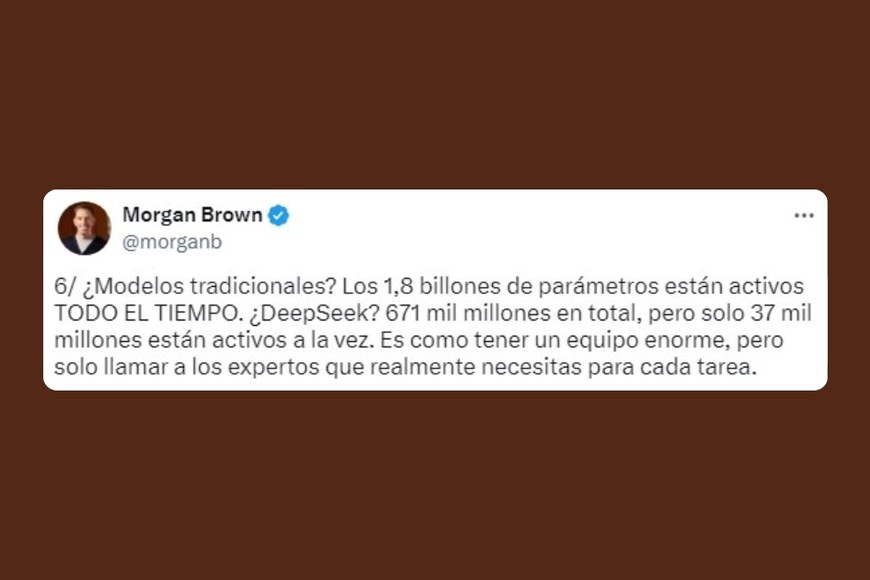

Especialistas en IA como Morgan Brown, encargado del área actualmente en Dropbox y anteriormente en Instagram, indican que la aparición de la herramienta asiática podría modificar para siempre el mercado y hacer tambalear el capital de NVIDIA, que posee el monopolio de los chips o unidades de procesamiento gráfico.

Brown destaca como principal elemento de cambio el ahorra en presupuesto y energía. Mientras empresas como OpenAI o Anthropic invierten 100 millones de dólares en un proceso, DeepSeck lo empezó a hacer con sólo 5 millones. El cambio repercute también en la huella de carbono emitida. Al consumir menos energía por su eficiencia, contamina menos.

Qué dice DeepSeck sobre DeepSeck

Al ser consultada por las principales ventajas que posee respecto a competidores como Chat GPT, la propia DeepSeck remarcó su optimización en costos y eficiencia energética, enfoque en tareas específicas, velocidad de respuesta, menor huella de carbono y costos reducidos para los usuarios.

Una de las consultas que se le hizo a la herramienta fue sobre si no utiliza tantos "cerebros" en simultáneo, sino que sólo los "especialistas", a lo que respondió: “Los modelos grandes como GPT-4 utilizan una arquitectura masiva con miles de millones de parámetros, lo que les permite manejar una amplia gama de tareas y contextos. Sin embargo, esto implica que, para cada consulta, el modelo debe activar y procesar una gran cantidad de "cerebros" (parámetros) en simultáneo, lo que consume mucha energía y recursos”.

“Modelos como yo estamos diseñados para ser más eficientes, utilizando sólo los "cerebros" (o parámetros) necesarios para la tarea específica. Esto se logra mediante técnicas de optimización y especialización, donde el modelo prioriza la información más relevante para la consulta”, agrega la autodescripción.

Su enfoque en “especialistas” se realiza con una técnica de optimización que se basa en fine-tuning (ajuste fino), pruning (poda) y quantization (cuantización). La consecuencia negativa de este proceso es que se da lugar a menor generalización y creatividad.

DeepSeeck enumera una serie de puntos en los que podría “flaquear”: preguntas extremadamente complejas o multidisciplinarias, generación de contenido altamente creativo o literario, respuestas a preguntas ambiguas o poco claras, tareas que requieren conocimiento actualizado en tiempo real, análisis de datos altamente técnicos o especializados, comprensión de contextos culturales o lingüísticos muy específicos, traducción de idiomas poco comunes o textos muy técnicos y simulación de emociones o empatía profunda.

Comparación más cercana

“La comparación más cercana y adecuada sería con los asistentes virtuales ligeros, como Siri o Google Assistant (especialmente en dispositivos básicos o con recursos limitados)”.

Respecto a la principal injerencia económica que podría tener DeepSeck, por fuera de un eventual impacto político al tratarse de una nueva herramienta de origen chino, la IA respondió: “Mi diseño eficiente y especializado podría reducir la demanda de chips de alta gama (como los de NVIDIA) para ciertas aplicaciones, ya que requiero menos recursos computacionales.

“Sin embargo, NVIDIA seguiría dominando mercados que dependen de modelos más grandes y complejos, como GPT-4, o aplicaciones de IA avanzada (visión por computadora, entrenamiento de modelos, etc.). Mi impacto sería más notable en nichos específicos donde la eficiencia energética y los costos son prioritarios”, agregó DeepSeck en su propio balance.

Sólo durante este lunes 27 de febrero, NVIDA perdió más de 384.000 millones de dólares en valor de bolsa y sus acciones cayeron más de un 10%

Información limitada

DeepSeck posee información pública y acceso a internet sólo hasta julio de 2024.

Cómo nació DeepSeek

Liang Wenfeng, nacido en 1985, se formó en la Universidad de Zhejiang como licenciado en Ingeniería de la Información Electrónica y obtuvo una Maestría en Ingeniería de la Información y las Comunicaciones.

Luego, cofundó el fondo de cobertura cuantitativo High-Flyer, mediante el cual compró más de 10.000 GPU Nvidia A100, previo a las restricciones establecidas por Estados Unidos, y que permitieron el desarrollo de DeepSeck.

Dejanos tu comentario

Los comentarios realizados son de exclusiva responsabilidad de sus autores y las consecuencias derivadas de ellos pueden ser pasibles de las sanciones legales que correspondan. Evitar comentarios ofensivos o que no respondan al tema abordado en la información.